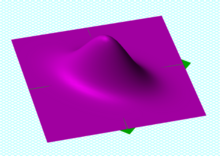

中心为 (0, 0) 的一个二元高斯概率密度函数 ,协方差矩阵为 [ 1.00, 0.50 ; 0.50, 1.00 ]。 一个左下右上方向标准差为 3,正交方向标准差为 1 的多元高斯分布 的样本点。由于 x 和 y 分量共变(即相关),x 与 y 的方差不能完全描述该分布;箭头的方向对应的协方差矩阵的特征向量,其长度为特征值 的平方根。 在统计学 与概率论 中,协方差 矩阵随机变量 协方差 ,是协方差 的直接推广。

定义

定义 —

(

Ω

,

Σ

,

P

)

{\displaystyle (\Omega ,\,\Sigma ,\,P)}

概率空间 ,

X

=

{

x

i

}

i

=

1

m

{\displaystyle X=\{x_{i}\}_{i=1}^{m))

Y

=

{

y

i

}

j

=

1

n

{\displaystyle Y=\{y_{i}\}_{j=1}^{n))

Ω

{\displaystyle \Omega }

实数 随机变量 序列

若二者对应的期望分别为:

E

(

x

i

)

=

∫

Ω

x

i

d

P

=

μ

i

{\displaystyle E(x_{i})=\int _{\Omega }x_{i}\,dP=\mu _{i))

E

(

y

j

)

=

∫

Ω

y

j

d

P

=

ν

j

{\displaystyle E(y_{j})=\int _{\Omega }y_{j}\,dP=\nu _{j))

则这两列随机变量间的协方差矩阵 为:

c

o

v

(

X

,

Y

)

:=

[

cov

(

x

i

,

y

j

)

]

m

×

n

=

[

E

[

(

x

i

−

μ

i

)

(

y

j

−

ν

j

)

]

]

m

×

n

{\displaystyle \operatorname {\mathbf {cov} } (X,Y):={\left[\,\operatorname {cov} (x_{i},y_{j})\,\right]}_{m\times n}=((\bigg [}\,\operatorname {E} [(x_{i}-\mu _{i})(y_{j}-\nu _{j})]\,{\bigg ]))_{m\times n))

将之以矩形表示的话就是:

c

o

v

(

X

,

Y

)

=

[

cov

(

x

1

,

y

1

)

cov

(

x

1

,

y

2

)

⋯

cov

(

x

1

,

y

n

)

cov

(

x

2

,

y

1

)

cov

(

x

2

,

y

2

)

⋯

cov

(

x

2

,

y

n

)

⋮

⋮

⋱

⋮

cov

(

x

m

,

y

1

)

cov

(

x

m

,

y

2

)

⋯

cov

(

x

m

,

y

n

)

]

{\displaystyle \operatorname {\mathbf {cov} } (X,Y)={\begin{bmatrix}\operatorname {cov} (x_{1},y_{1})&\operatorname {cov} (x_{1},y_{2})&\cdots &\operatorname {cov} (x_{1},y_{n})\\\operatorname {cov} (x_{2},y_{1})&\operatorname {cov} (x_{2},y_{2})&\cdots &\operatorname {cov} (x_{2},y_{n})\\\vdots &\vdots &\ddots &\vdots \\\operatorname {cov} (x_{m},y_{1})&\operatorname {cov} (x_{m},y_{2})&\cdots &\operatorname {cov} (x_{m},y_{n})\end{bmatrix))}

=

[

E

[

(

x

1

−

μ

1

)

(

y

1

−

ν

1

)

]

E

[

(

x

1

−

μ

1

)

(

y

2

−

ν

2

)

]

⋯

E

[

(

x

1

−

μ

1

)

(

y

n

−

ν

n

)

]

E

[

(

x

2

−

μ

2

)

(

y

1

−

ν

1

)

]

E

[

(

x

2

−

μ

2

)

(

y

2

−

ν

2

)

]

⋯

E

[

(

x

2

−

μ

2

)

(

y

n

−

ν

n

)

]

⋮

⋮

⋱

⋮

E

[

(

x

m

−

μ

m

)

(

y

1

−

ν

1

)

]

E

[

(

x

m

−

μ

m

)

(

y

2

−

ν

2

)

]

⋯

E

[

(

x

m

−

μ

m

)

(

y

n

−

ν

n

)

]

]

{\displaystyle ={\begin{bmatrix}\mathrm {E} [(x_{1}-\mu _{1})(y_{1}-\nu _{1})]&\mathrm {E} [(x_{1}-\mu _{1})(y_{2}-\nu _{2})]&\cdots &\mathrm {E} [(x_{1}-\mu _{1})(y_{n}-\nu _{n})]\\\mathrm {E} [(x_{2}-\mu _{2})(y_{1}-\nu _{1})]&\mathrm {E} [(x_{2}-\mu _{2})(y_{2}-\nu _{2})]&\cdots &\mathrm {E} [(x_{2}-\mu _{2})(y_{n}-\nu _{n})]\\\vdots &\vdots &\ddots &\vdots \\\mathrm {E} [(x_{m}-\mu _{m})(y_{1}-\nu _{1})]&\mathrm {E} [(x_{m}-\mu _{m})(y_{2}-\nu _{2})]&\cdots &\mathrm {E} [(x_{m}-\mu _{m})(y_{n}-\nu _{n})]\end{bmatrix))}

根据测度积分 的线性性质,协方差矩阵还可以进一步化简为:

c

o

v

(

X

,

Y

)

=

[

E

(

x

i

y

j

)

−

μ

i

ν

j

]

n

×

n

{\displaystyle \operatorname {\mathbf {cov} } (X,Y)={\left[\,\operatorname {E} (x_{i}y_{j})-\mu _{i}\nu _{j}\,\right]}_{n\times n))

矩阵表示法

以上定义所述的随机变量序列

X

{\displaystyle X}

Y

{\displaystyle Y}

行向量

X

:=

[

x

i

]

m

{\displaystyle \mathbf {X} :={\left[x_{i}\right]}_{m))

Y

:=

[

y

j

]

n

{\displaystyle \mathbf {Y} :={\left[y_{j}\right]}_{n))

X

:=

[

x

1

x

2

⋮

x

m

]

{\displaystyle \mathbf {X} :={\begin{bmatrix}x_{1}\\x_{2}\\\vdots \\x_{m}\end{bmatrix))}

Y

:=

[

y

1

y

2

⋮

y

n

]

{\displaystyle \mathbf {Y} :={\begin{bmatrix}y_{1}\\y_{2}\\\vdots \\y_{n}\end{bmatrix))}

这样的话,对于

m

×

n

{\displaystyle m\times n}

Ω

{\displaystyle \Omega }

a

i

j

{\displaystyle a_{ij))

A

=

[

a

i

j

]

m

×

n

{\displaystyle \mathbf {A} ={\left[\,a_{ij}\,\right]}_{m\times n))

E

[

A

]

:=

[

E

(

a

i

j

)

]

m

×

n

{\displaystyle \mathrm {E} [\mathbf {A} ]:={\left[\,\operatorname {E} (a_{ij})\,\right]}_{m\times n))

也就是说

E

[

A

]

:=

[

E

(

a

11

)

E

(

a

12

)

⋯

E

(

a

1

n

)

E

(

a

21

)

E

(

a

22

)

⋯

E

(

a

2

n

)

⋮

⋮

⋱

⋮

E

(

a

m

1

)

E

(

a

m

2

)

⋯

E

(

a

m

n

)

]

{\displaystyle \mathrm {E} [\mathbf {A} ]:={\begin{bmatrix}\operatorname {E} (a_{11})&\operatorname {E} (a_{12})&\cdots &\operatorname {E} (a_{1n})\\\operatorname {E} (a_{21})&\operatorname {E} (a_{22})&\cdots &\operatorname {E} (a_{2n})\\\vdots &\vdots &\ddots &\vdots \\\operatorname {E} (a_{m1})&\operatorname {E} (a_{m2})&\cdots &\operatorname {E} (a_{mn})\end{bmatrix))}

那上小节定义的协方差矩阵就可以记为:

c

o

v

(

X

,

Y

)

=

E

[

(

X

−

E

[

X

]

)

(

Y

−

E

[

Y

]

)

T

]

{\displaystyle \operatorname {\mathbf {cov} } (X,Y)=\mathrm {E} \left[\left(\mathbf {X} -\mathrm {E} [\mathbf {X} ]\right)\left(\mathbf {Y} -\mathrm {E} [\mathbf {Y} ]\right)^{\rm {T))\right]}

所以协方差矩阵也可对

X

{\displaystyle \mathbf {X} }

Y

{\displaystyle \mathbf {Y} }

c

o

v

(

X

,

Y

)

:=

E

[

(

X

−

E

[

X

]

)

(

Y

−

E

[

Y

]

)

T

]

{\displaystyle \operatorname {\mathbf {cov} } (\mathbf {X} ,\mathbf {Y} ):=\mathrm {E} \left[\left(\mathbf {X} -\mathrm {E} [\mathbf {X} ]\right)\left(\mathbf {Y} -\mathrm {E} [\mathbf {Y} ]\right)^{\rm {T))\right]}

术语与符号分歧

也有人把以下的

Σ

X

{\displaystyle \mathbf {\Sigma } _{X))

Σ

X

:=

[

cov

(

x

i

,

x

j

)

]

m

×

m

=

c

o

v

(

X

,

X

)

{\displaystyle {\begin{aligned}\mathbf {\Sigma } _{X}&:={\left[\operatorname {cov} (x_{i},x_{j})\right]}_{m\times m}\\&=\operatorname {\mathbf {cov} } (X,X)\end{aligned))}

但本页面沿用威廉·费勒 的说法,把

Σ

X

{\displaystyle \mathbf {\Sigma } _{X))

X

{\displaystyle X}

c

o

v

(

X

,

Y

)

{\displaystyle \operatorname {\mathbf {cov} } (X,Y)}

cov

(

x

i

,

x

i

)

=

E

[

(

x

i

−

μ

i

)

2

]

=

var

(

x

i

)

{\displaystyle \operatorname {cov} (x_{i},x_{i})=\operatorname {E} [{(x_{i}-\mu _{i})}^{2}]=\operatorname {var} (x_{i})}

换句话说,

Σ

X

{\displaystyle \mathbf {\Sigma } _{X))

x

i

{\displaystyle x_{i))

方差 所组成。据此,也有人也把

c

o

v

(

X

,

Y

)

{\displaystyle \operatorname {\mathbf {cov} } (X,Y)}

方差-协方差矩阵 (variance–covariance matrix)。

更有人因为方差 和离差 的相关性,含混的将

c

o

v

(

X

,

Y

)

{\displaystyle \operatorname {\mathbf {cov} } (X,Y)}

离差矩阵 。

性质

Σ

=

c

o

v

(

X

,

X

)

{\displaystyle \mathbf {\Sigma } =\operatorname {\mathbf {cov} } (X,X)}

Σ

=

E

(

X

X

T

)

−

E

(

X

)

[

E

(

X

)

]

T

{\displaystyle \mathbf {\Sigma } =\mathrm {E} (\mathbf {X} \mathbf {X} ^{T})-\mathrm {E} (\mathbf {X} ){[\mathrm {E} (\mathbf {X} )]}^{T))

Σ

{\displaystyle \mathbf {\Sigma } }

半正定 的和对称 的矩阵。

var

(

a

T

X

)

=

a

T

var

(

X

)

a

{\displaystyle \operatorname {var} (\mathbf {a^{T)) \mathbf {X} )=\mathbf {a^{T)) \operatorname {var} (\mathbf {X} )\mathbf {a} }

Σ

≥

0

{\displaystyle \mathbf {\Sigma } \geq 0}

var

(

A

X

+

a

)

=

A

var

(

X

)

A

T

{\displaystyle \operatorname {var} (\mathbf {AX} +\mathbf {a} )=\mathbf {A} \operatorname {var} (\mathbf {X} )\mathbf {A^{T)) }

cov

(

X

,

Y

)

=

cov

(

Y

,

X

)

T

{\displaystyle \operatorname {cov} (\mathbf {X} ,\mathbf {Y} )=\operatorname {cov} (\mathbf {Y} ,\mathbf {X} )^{T))

cov

(

X

1

+

X

2

,

Y

)

=

cov

(

X

1

,

Y

)

+

cov

(

X

2

,

Y

)

{\displaystyle \operatorname {cov} (\mathbf {X_{1)) +\mathbf {X_{2)) ,\mathbf {Y} )=\operatorname {cov} (\mathbf {X_{1)) ,\mathbf {Y} )+\operatorname {cov} (\mathbf {X_{2)) ,\mathbf {Y} )}

若

p

=

q

{\displaystyle p=q}

var

(

X

+

Y

)

=

var

(

X

)

+

cov

(

X

,

Y

)

+

cov

(

Y

,

X

)

+

var

(

Y

)

{\displaystyle \operatorname {var} (\mathbf {X} +\mathbf {Y} )=\operatorname {var} (\mathbf {X} )+\operatorname {cov} (\mathbf {X} ,\mathbf {Y} )+\operatorname {cov} (\mathbf {Y} ,\mathbf {X} )+\operatorname {var} (\mathbf {Y} )}

cov

(

A

X

,

B

X

)

=

A

cov

(

X

,

X

)

B

T

{\displaystyle \operatorname {cov} (\mathbf {AX} ,\mathbf {BX} )=\mathbf {A} \operatorname {cov} (\mathbf {X} ,\mathbf {X} )\mathbf {B} ^{T))

若

X

{\displaystyle \mathbf {X} }

Y

{\displaystyle \mathbf {Y} }

cov

(

X

,

Y

)

=

0

{\displaystyle \operatorname {cov} (\mathbf {X} ,\mathbf {Y} )=0}

Σ

=

Σ

T

{\displaystyle \mathbf {\Sigma } =\mathbf {\Sigma } ^{T))

尽管协方差矩阵很简单,可它却是很多领域里的非常有力的工具。它能导出一个变换矩阵 ,这个矩阵能使数据完全去相关(decorrelation)。从不同的角度看,也就是说能够找出一组最佳的基以紧凑的方式来表达数据。(完整的证明请参考瑞利商 )。

这个方法在统计学中被称为主成分分析 (principal components analysis),在图像处理中称为Karhunen-Loève 变换(KL-变换)。

估计

多元正态分布 的协方差矩阵的估计的推导非常精致. 它需要用到谱定义以及为什么把标量看做

1

×

1

{\displaystyle 1\times 1}

![{\displaystyle \operatorname {\mathbf {cov} } (X,Y):={\left[\,\operatorname {cov} (x_{i},y_{j})\,\right]}_{m\times n}=((\bigg [}\,\operatorname {E} [(x_{i}-\mu _{i})(y_{j}-\nu _{j})]\,{\bigg ]))_{m\times n))](https://wikimedia.org/api/rest_v1/media/math/render/svg/a5156794b781f959d02adb93d3b439bfb543fdf3)

![{\displaystyle ={\begin{bmatrix}\mathrm {E} [(x_{1}-\mu _{1})(y_{1}-\nu _{1})]&\mathrm {E} [(x_{1}-\mu _{1})(y_{2}-\nu _{2})]&\cdots &\mathrm {E} [(x_{1}-\mu _{1})(y_{n}-\nu _{n})]\\\mathrm {E} [(x_{2}-\mu _{2})(y_{1}-\nu _{1})]&\mathrm {E} [(x_{2}-\mu _{2})(y_{2}-\nu _{2})]&\cdots &\mathrm {E} [(x_{2}-\mu _{2})(y_{n}-\nu _{n})]\\\vdots &\vdots &\ddots &\vdots \\\mathrm {E} [(x_{m}-\mu _{m})(y_{1}-\nu _{1})]&\mathrm {E} [(x_{m}-\mu _{m})(y_{2}-\nu _{2})]&\cdots &\mathrm {E} [(x_{m}-\mu _{m})(y_{n}-\nu _{n})]\end{bmatrix))}](https://wikimedia.org/api/rest_v1/media/math/render/svg/7e9a5a14766d082923ed9e794213088c3c32d7ac)

![{\displaystyle \operatorname {\mathbf {cov} } (X,Y)={\left[\,\operatorname {E} (x_{i}y_{j})-\mu _{i}\nu _{j}\,\right]}_{n\times n))](https://wikimedia.org/api/rest_v1/media/math/render/svg/a813988c7371dfa7dedb84fdaaf86a286bf02b38)

![{\displaystyle \mathbf {X} :={\left[x_{i}\right]}_{m))](https://wikimedia.org/api/rest_v1/media/math/render/svg/96aafe9bf2396bad8aeb8cd26bb9238d30980f79)

![{\displaystyle \mathbf {Y} :={\left[y_{j}\right]}_{n))](https://wikimedia.org/api/rest_v1/media/math/render/svg/bc7061e7cbd2f5e2b0b5dec6628b26ca0ebcabe2)

![{\displaystyle \mathbf {A} ={\left[\,a_{ij}\,\right]}_{m\times n))](https://wikimedia.org/api/rest_v1/media/math/render/svg/d523a9b473aa9f1703fb22dcd25a3a707d80fb9b)

![{\displaystyle \mathrm {E} [\mathbf {A} ]:={\left[\,\operatorname {E} (a_{ij})\,\right]}_{m\times n))](https://wikimedia.org/api/rest_v1/media/math/render/svg/60afd661ab70521d030a0a969b98b5f27fd970b1)

![{\displaystyle \mathrm {E} [\mathbf {A} ]:={\begin{bmatrix}\operatorname {E} (a_{11})&\operatorname {E} (a_{12})&\cdots &\operatorname {E} (a_{1n})\\\operatorname {E} (a_{21})&\operatorname {E} (a_{22})&\cdots &\operatorname {E} (a_{2n})\\\vdots &\vdots &\ddots &\vdots \\\operatorname {E} (a_{m1})&\operatorname {E} (a_{m2})&\cdots &\operatorname {E} (a_{mn})\end{bmatrix))}](https://wikimedia.org/api/rest_v1/media/math/render/svg/83249bbd99a43a8ea8379d8a17a55fdbcf1e4f89)

![{\displaystyle \operatorname {\mathbf {cov} } (X,Y)=\mathrm {E} \left[\left(\mathbf {X} -\mathrm {E} [\mathbf {X} ]\right)\left(\mathbf {Y} -\mathrm {E} [\mathbf {Y} ]\right)^{\rm {T))\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/89f92295929a9d0e5ddbc2c184f2aff142268c7d)

![{\displaystyle \operatorname {\mathbf {cov} } (\mathbf {X} ,\mathbf {Y} ):=\mathrm {E} \left[\left(\mathbf {X} -\mathrm {E} [\mathbf {X} ]\right)\left(\mathbf {Y} -\mathrm {E} [\mathbf {Y} ]\right)^{\rm {T))\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/b03cb33d4dec223e53e0ca7875851a47fdfb66db)

![{\displaystyle {\begin{aligned}\mathbf {\Sigma } _{X}&:={\left[\operatorname {cov} (x_{i},x_{j})\right]}_{m\times m}\\&=\operatorname {\mathbf {cov} } (X,X)\end{aligned))}](https://wikimedia.org/api/rest_v1/media/math/render/svg/a31fca254cb3233a0b0aaa7840af35d0ef361307)

![{\displaystyle \operatorname {cov} (x_{i},x_{i})=\operatorname {E} [{(x_{i}-\mu _{i})}^{2}]=\operatorname {var} (x_{i})}](https://wikimedia.org/api/rest_v1/media/math/render/svg/f698aa1156b519c0dd1cadb8440b3b4c8c042ec0)

![{\displaystyle \mathbf {\Sigma } =\mathrm {E} (\mathbf {X} \mathbf {X} ^{T})-\mathrm {E} (\mathbf {X} ){[\mathrm {E} (\mathbf {X} )]}^{T))](https://wikimedia.org/api/rest_v1/media/math/render/svg/f467eb02422f2ac50eae7beff565c80fe03ae8e4)

![{\displaystyle \operatorname {var} (z)=\operatorname {E} \left[(z-\mu )(z-\mu )^{*}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/c660060a82fca0c8cb8dc94bf04136bc62d02d27)

![{\displaystyle \operatorname {E} \left[(Z-\mu )(Z-\mu )^{*}\right]}](https://wikimedia.org/api/rest_v1/media/math/render/svg/ef98d37f31cddf1eb47261f0bb4ba0942202ea40)